Transkript anzeigen (falls vorhanden)

Deepfakes wirken echt, sind aber reine Fantasiegeburten: Videos und Bilder, die anhand eines Textprompts von einer generativen KI erzeugt wurden und lustig, originell oder auch verblüffend sind – zumindest in ihrer harmlosen Ausprägung.

Doch in vielen Fällen werden die Bilder zu manipulativen Zwecken eingesetzt: als Propaganda-Instrument, in Form von «AI Slop» zur Aufmerksamkeitsbewirtschaftung in den sozialen Medien und schliesslich auch bei Identitätsdiebstahl und «Deep Nudes» – das sind sexualisierte Deepfakes, die zu privaten «Vergnügen» verwendet oder auch veröffentlicht werden.

Spätestens seit Elon Musks KI Grok solche Bilder mit minimalem Aufwand via Twitter (X) erzeugt, ist eine eigentliche Deepfake-Epidemie zu beobachten.

Wir diskutieren über das Problem: Welche Handhabe haben wir als Betroffene, was können wir gegen solche Deepfakes tun? Welche Möglichkeiten der Prävention gibt es? Und was müsste der Gesetzgeber tun, damit die Last, gegen solche Formen des digitalen Missbrauchs vorzugehen, nicht auf den Schultern der einzelnen Opfer liegt?

Die Links zur Episode

- Definition Wikipedia

- Bildbasierte Gewalt im Internet: Von Dickpics und Deepnudes

- So funktioniert der Krieg der Bilder – heute und schon viel früher

- Fake Views: The Good, The Bad, And The Ugly Of Soviet Photoshopping

- Facebook wird zum KI-Misthaufen

- Facebook tut gar nichts gegen das riesige Deepfake-Problem

- Die Rangliste der idiotischsten Deepfake-Motive auf Facebook

- KI sei Dank streamt Jesus jetzt live vom Kreuz

- KI-Chatbot Grok sorgt auf X für massenhafte Nacktbilder ohne Zustimmung der Betroffenen

- Wenn intime Fotos mit Technologie zur Waffe gegen Frauen werden

- «Du hast mich virtuell vergewaltigt»

- Was ist sexualisierte Gewalt im Netz?

- Bei Whatsapp nervt die KI, bei Facebook die Deepfake-Flut

- Dänemarks Regierung will «Copyright» auf eigene Stimme, Gesicht und Körper verankern

- The Danish approach to copyright and deepfakes: A model for the EU?

- Streit um Strafbarkeit von Deepfakes

- Das können Eltern tun, damit das Kinderfoto im Netz nicht zum Albtraum wird

- Sofortmassnahmen bei digitalem Missbrauch – Sie haben einen Deepfake von sich entdeckt: Was Sie jetzt unbedingt tun sollten

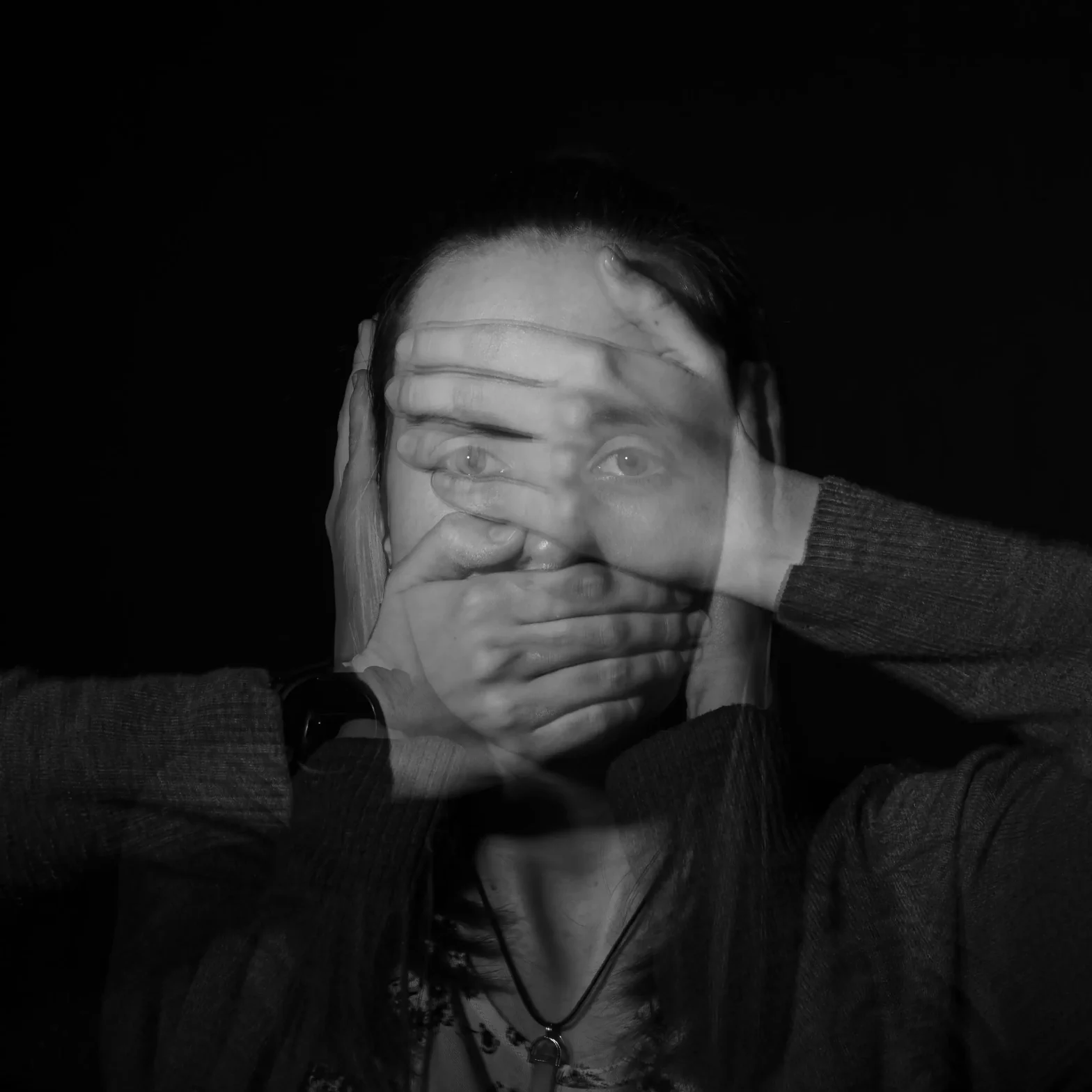

Beitragsbild: Wie verstecken wir uns von den KI-Algorithmen, die uns unsere Identität nach Belieben verwenden, verfremden und stehlen (Alex Vámos, Unsplash-Lizenz)?